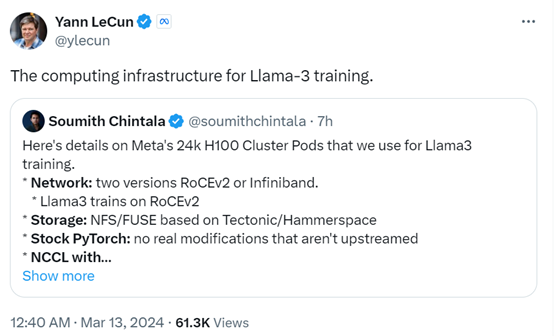

2024年3月13日,科技社交巨头Meta震撼官宣,在其官网上披露了两个搭载49,152颗全新24K H100 GPU的超级集群,致力于驱动大模型Llama-3的高效训练。

此外,Llama-3搭载RoCEv2网络技术,采用Tectonic/Hammerspace构建的NFS/FUSE网络存储方案,并持续运用PyTorch机器学习库,实现高效能运算。

预计 Llama-3 将于 4月末至5月中旬闪电上线,受 Sora 启迪,有望成为一款革命性的多模态模型,并坚持开源理念。

Meta 预计,至 2024 年,将部署 600,000 枚 H100 芯片,构建强大算力矩阵,赋能未来科技进程。

Meta首席科学家确认

Meta 庞大的 AI 算力集群

Meta,全球科技巨头,倾力投入AI研发,矢志构建惠及全人类的通用人工智能(AGI),以实现科技巅峰价值。

2022年1月24日,Meta震撼披露其AI研究超级集群(RSC)的详尽信息,该集群搭载了空前强大的16,000块英伟达A100 GPU。

该团队在研发全球爆款类 ChatGPT 模型 Llama 系列(Llama & Llama 2)中担当核心角色,同时深度参与计算机视觉、NLP、语音识别和图像生成等前沿技术革新。

基于RSC辉煌实践,全新GPU集群横空出世,每集群配备24,576颗H100 GPU,赋能更复杂、参数量更高的大模型训练,突破以往极限。

集群网络

融合以太网远程直接内存访问(RoCE)网络架构的解决方案强势登场,依托Arista7800、Wedge400及Minipack2 OCP机架交换机组建的集群为核心,实现高效数据传输与计算力整合。

搭载NVIDIA Quantum-2 InfiniBand架构,实现400 Gbps端点高效互连,两者皆展现卓越性能。

借助双集群支持,Meta精准评测各类互联技术在大规模训练中的适用性与可扩展性,为未来打造更大规模集群提供实战洞见与设计经验。

此外,Meta 已高效运用RoCE与InfiniBand集群架构,承载大规模生成式AI任务,例如Llama 3在RoCE集群上的训练过程,全程网络流畅,无任何瓶颈显现。

硬件平台

两大全新集群搭载 Meta 独家研发的 Grand Teton 开放性 GPU 硬件平台,该创新设计于 2022 年 10 月 18 日震撼首发,实力诠释尖端科技魅力。

Grand Teton,搭载多代人工智能技术,集电源、控制、计算与结构接口于一体,机箱整合实现卓越的整体性能、信号完整性和散热效能。设计精简,灵活易部署,可迅速融入数据中心集群,并具备便捷维护和无缝扩展优势。

数据存储

Meta创新打造的用户空间Linux文件系统API,专为人工智能集群定制,高效满足其海量数据和检查点需求。这一关键技术由Meta优化的Tectonic分布式存储解决方案提供动力,针对闪存媒体深度优化,实现全新集群存储部署,展现卓越性能表现。

此方案独树一帜,高效同步数千GPU的检查点存储与加载,攻克业界存储难题。并配备灵活、高吞吐的外字节级存储,满足海量数据疾速加载需求。

Meta联手Hammerspace,共同研发并部署高性能并行NFS,满足超级AI集群环境下开发者的严苛存储需求。

Hammerspace助力工程师实现突破,支持数千GPU实时交互式调试作业,任何节点皆可即时获取代码更新,提升工作效率。

融合Meta的Tectonic分布式存储技术与Hammerspace,实现无缝功能迭代,即使在大规模环境下,也能确保高效快速。

-对此,您有什么看法见解?-

-欢迎在评论区留言探讨和分享。-